在科技的浪潮中,自动驾驶已然成为人类迈向未来的必由之路。然而,随着技术的不断演进,我们正逐步迈入自动驾驶3.0时代——这是一个由大模型主导的新纪元。过去,自动驾驶技术依赖于传统的算法和模型,但如今,随着人工智能的巨大进步,大型深度学习模型正以前所未有的方式塑造着自动驾驶的未来。让我们探索一下,在这个令人兴奋的时代,大模型将如何改变自动驾驶。

Transformer引领大型模型时代

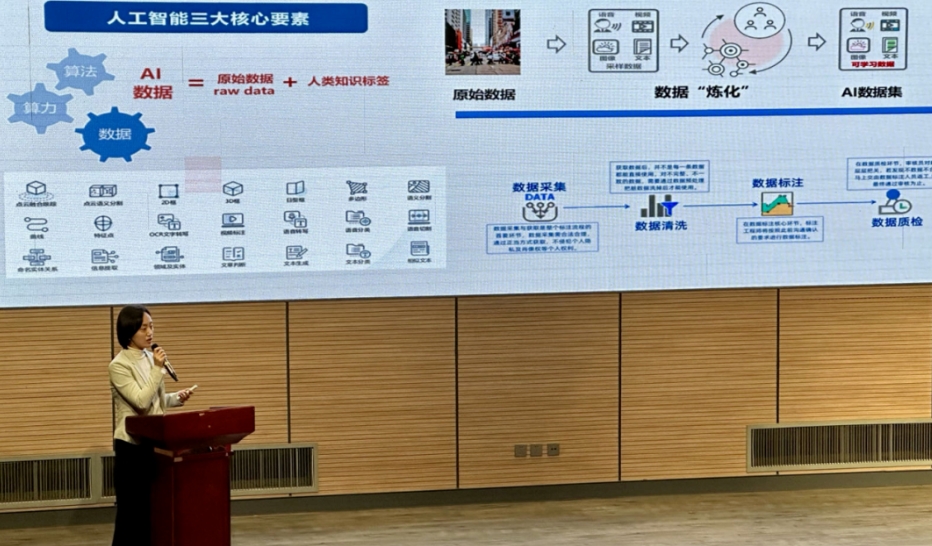

在大型模型中,参数数量常常达到数十亿甚至数百亿。这一庞大的规模赋予了它们处理更加复杂任务的能力。其中,大型语言模型(LLMs)尤为典型,借助海量数据集进行内容识别、总结、翻译、预测以及生成。

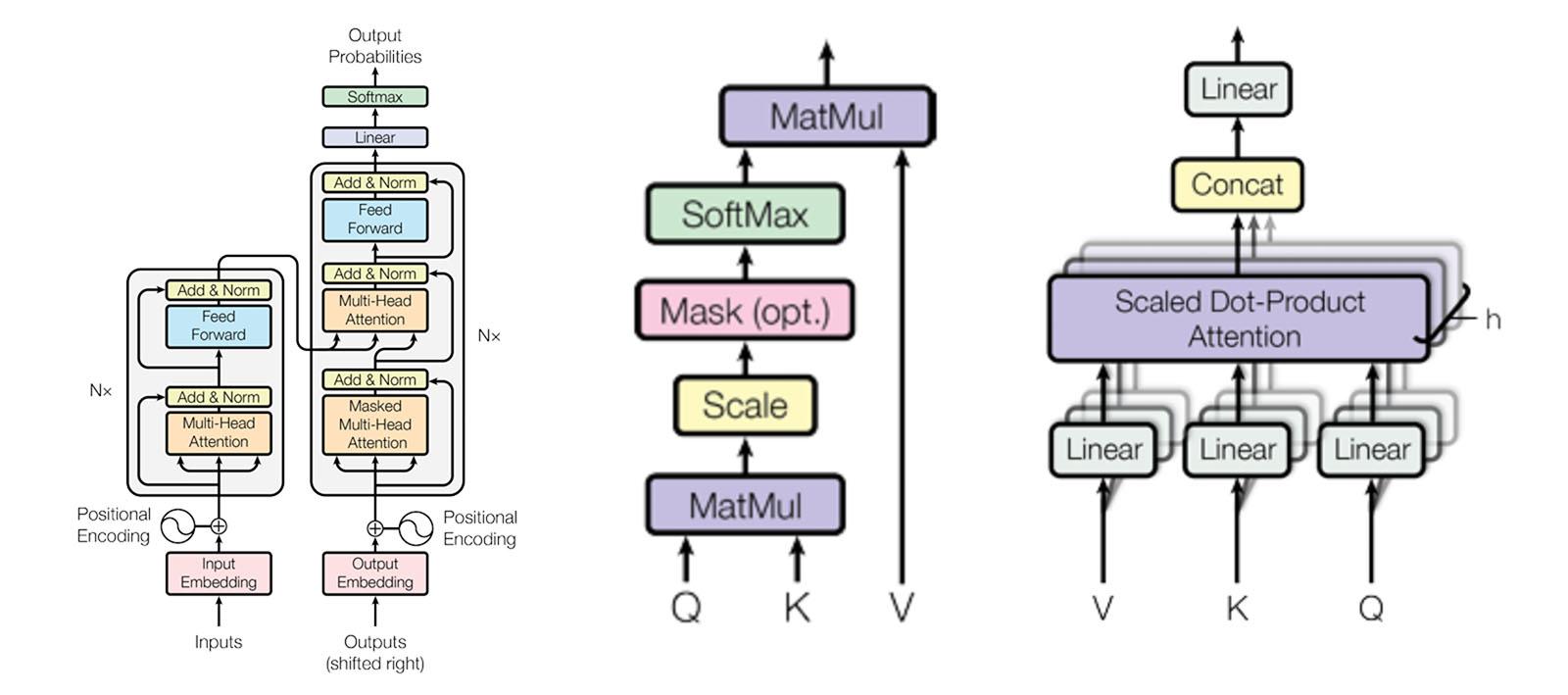

这一系列大型语言模型在很大程度上代表了一种名为Transformer的深度学习架构。Transformer通过追踪数据序列中的关联关系来学习上下文和语义含义。正是Transformer引领着大型语言模型的崭新时代。

在传统的神经网络模型中,通常会采用卷积操作或递归结构来处理序列数据。然而,这些方法在处理长距离依赖关系时存在一定的限制。相比之下,Transformer通过引入自注意力机制,使模型能够自动学习序列中不同位置的相关性和重要性,从而更好地捕捉序列中的长距离依赖关系。

倍赛科技作为国内领先的AI基础数据服务商,具备完备的数据供给全产业链能力。可提供丰富、多样的训练数据,满足不同领域、不同模型的需求,为人工智能技术的不断进步提供坚实的数据支撑。

这项技术已经在许多领域得到了广泛应用。像GPT这类大型语言模型可以深入捕捉复杂的语义信息,实现与人类水平相媲美的交互。在医疗保健领域,这些模型能够处理图像和报告,辅助医生进行诊断。而在自动驾驶领域,它们具有分析多模态传感器数据的潜力,从而提高对复杂场景的理解和决策能力。

Transformers + BEV

Bird's Eye View(BEV)模型的核心思想在于将车辆周围的3D环境数据(如来自LiDAR、摄像头等的数据)投影到鸟瞰视图平面上,生成2D地图。这样的BEV地图使我们能够更清晰地观察道路、车辆、标志等元素的位置和关系,这有助于路径规划和决策制定。BEV模型能够将来自多个传感器的输入信息整合为共享的表示,从而提供更一致和全面的环境信息。

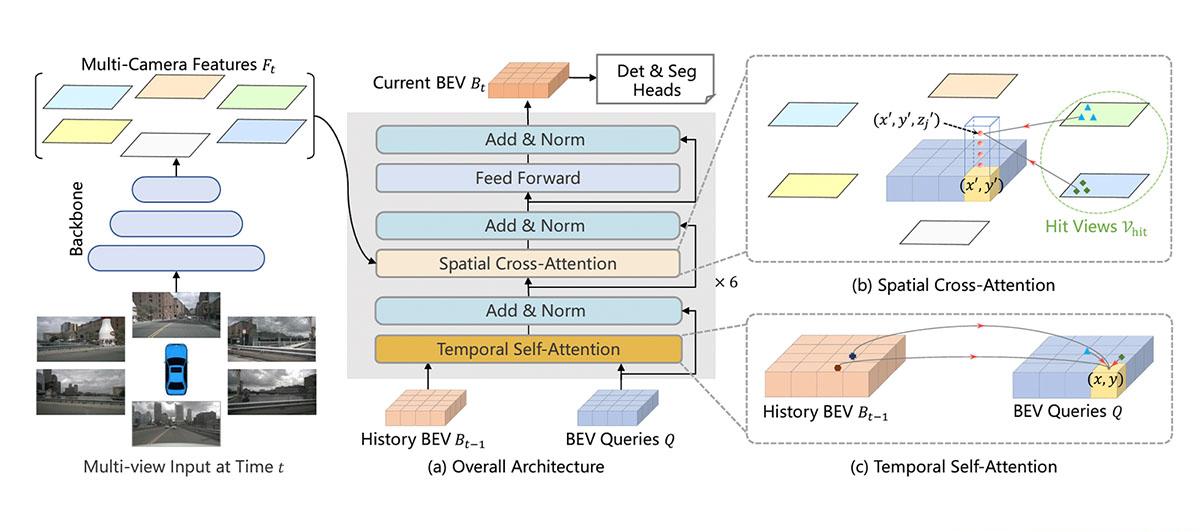

BEV模型需要复杂的校准和数据处理,对计算资源要求高。它将3D环境数据投影到2D地图上,但会丢失一些信息。自2020年以来,人们开始结合Transformer和BEV,形成一种新的解决方案。

Transformer在处理序列数据和复杂语境方面表现出独特优势,在NLP领域得到验证。它也能处理多源数据。而BEV模型则能有效地表达空间信息。将它们结合起来,可以实现更精确的感知、更长距离的规划和更全球性的决策。

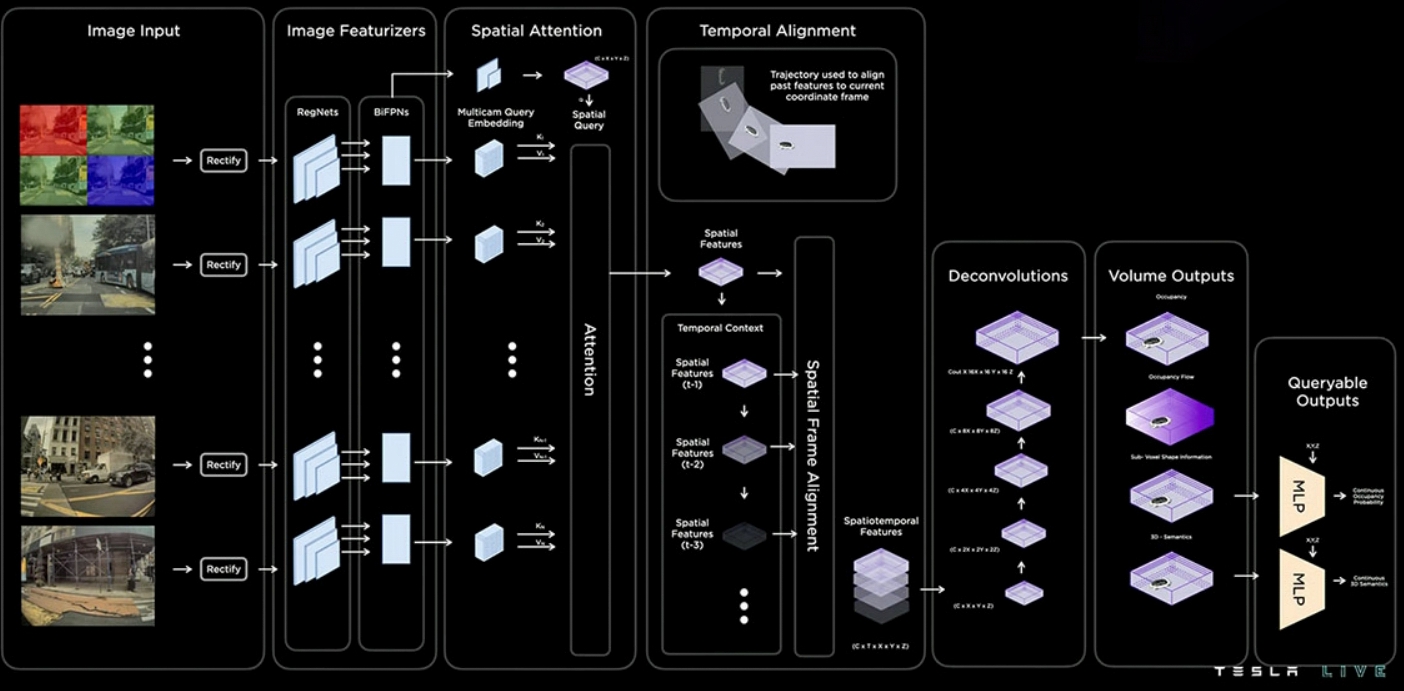

但需要指出的是,BEV模型更适合车道等平面结构,而不是对3D体积的准确描述。因此,特斯拉在2023年发布了占用网络模型,对BEV进行了升级。

占用网络

与BEV相比,占用网络能够更准确地重建3D环境,从而增强感知能力。这些网络由一个学习丰富语义的编码器和一个生成3D表示的解码器组成。它们通过学习将3D表面表示为神经网络决策边界,无需依赖LiDAR点云,将感知的几何形状和语义整合在一起,以获取准确的场景信息。占用网络技术使得特斯拉能够充分利用未标记的数据,有效地补充标记的数据集,提高了安全性并减少了事故的发生。

自动驾驶在大型模型时代的启示

类似于GPT的大型模型通常采用Transformer结构进行分布式训练,这激发了自动驾驶研究人员采用相似的架构进行端到端学习,甚至专门为自动驾驶设计预训练模型。

预训练使得模型能够获得强大的语义表示,从而理解复杂或异常的场景,并提升稳健的感知能力。它们也更适应新环境的变化。通过对序列进行精细建模,大型模型可以随着时间的推移推断因果关系,并更好地预测动态环境的变化。它们能够整合不同的多模态输入(如图像、点云等),实现对场景的全面理解。大型模型具有直接从传感器输入到驾驶输出进行端到端学习的能力,简化了架构设计。

大型模型的应用为L3/L4级别的自动驾驶设定了更清晰的预期。特斯拉采用了Transformer + BEV + 占用网络算法,使车辆能够更准确地理解复杂的交通情况,提供了更强的L3/L4级别的环境感知。这些优化算法为环境认知提供了高效准确的数据处理,实现了显著的感知、决策和控制进步。辅助实时规划和决策使得在复杂环境中安全驾驶成为可能,为商业应用奠定了基础。

自动驾驶带来的需求变化

尽管大模型在自动驾驶中的应用仍处于早期阶段,但目前仍存在着多种挑战,如多模态融合、大量计算需求、车载部署以及智能车辆的安全性和一致性等问题。然而,随着优化和应用的推进,大型模型在自动驾驶中的作用可能会迅速增加。

4D传感器需求增加

目前,激光雷达仍然是智能汽车的主要辅助传感器,具备卓越的距离和空间精度。结合多传感器融合技术,可以实现全方位的感知,提供更高级别的冗余。此外,随着技术的进步和规模化生产,激光雷达的成本也将逐步降低。短期内,预计激光雷达仍将保持其重要性。但新型传感器,如4D成像雷达,可能会成为未来智能汽车的新选择。4D雷达将俯仰角感知添加到传统雷达中,呈现了丰富的点云图像,包括目标和环境的距离、速度和角度信息。它们适应了更复杂的条件,如小型、被遮挡的和静止的横向移动物体。预计这种新技术将迅速应用于中高端和自动驾驶车型中。

人机耦合多传感器融合标注成为必要

在大型模型和传感器成本下降的推动下,自动驾驶正在全面向着L3+级别发展。L3+级别在很大程度上依赖于计算机视觉,需要实时传感器数据处理来构建驾驶环境,以供预测和决策,这带来了算法准确性和实时性方面的挑战。目前,监督学习仍然是主要方法,需要大量标注数据集进行训练和优化。根据Dimensional Research的全球调查,72%的人认为需要超过10万个训练数据来确保模型的有效性和可靠性。同时,96%的人在训练模型时遇到了训练数据质量/数量不足和标注人员问题。

鉴于巨大的数据需求,人机协同标注将成为新的范式,提高效率并节省成本。与此同时,L3+级别的自动驾驶需要大量的3D点云数据支持,标注难度高,这给行业带来了更大的挑战。

倍赛科技

倍赛科技专注于提供专业的数据集,用于AI算法模型的开发和训练。自成立以来,建立了一套完整的AI全生命周期软件及服务体系,涵盖了从数据标注、AI数据管理到模型训练的全方位支持。点云标注套件特别针对自动驾驶领域,提供了2D&3D传感器融合标注、语义分割、3D物体跟踪等功能,实现了自动化标注,效率提升了82%,已成为行业标杆。此外,倍赛科技还率先推出了4D BEV数据标注支持,为强大的L3+算法数据提供训练。

上一篇

下一篇